3 ChatGPT-Musikprompts zum Generieren von Akkorden und Texten in 2026

Der neueste Chatbot von OpenAI, ChatGPT, hat im Internet eine Kontroverse ausgelöst. Die Tiefe und Genauigkeit von ChatGPTs Textgenerierung ist selbst für diejenigen schockierend, die die neuesten Entwicklungen in der KI verfolgt haben.

Im Jahr 2022 bewiesen generative Bilddienste wie Dalle-2, MidJourney und Stable Diffusion, dass künstliche Intelligenz in Sekundenschnelle realistische Bilder erzeugen kann. Konzeptkünstler, die früher angeheuert wurden, um Charaktere und Szenen für einen Kreativdirektor zu skizzieren, können jetzt leicht ersetzt werden.

Am 26. Januar 2026 veröffentlichte Google ein Dokument, in dem ein neuer Text-zu-Musik-Generator namens MusicLM beschrieben wird.

Was bedeutet das alles für Musiker? Algorithmen des maschinellen Lernens können schon jetzt jede Art von Bildern aus einer Eingabeaufforderung erzeugen. Es wird nicht mehr lange dauern, bis neuronale Netze auch Musikstücke erzeugen. Stücke, die klingen, als wären sie von einem Menschen geschaffen worden.

OpenAI hat bereits in der Vergangenheit Tools zur Musikerzeugung wie MuseNet und JukeBox veröffentlicht. Diese Anwendungen waren bisher eher eine Kuriosität als eine echte Bedrohung. Keines von ihnen hat realistische, originalgetreue Musik erzeugt. Das liegt zum Teil daran, dass neuronale Netze nur schwer langfristige Strukturen wie einen kompletten Song erzeugen können.

MuseNet ermöglicht es den Nutzern, MIDI-Dateien anhand von allgemeinen Parametern wie Genre und Künstler zu exportieren. Jukebox ging noch einen Schritt weiter und produzierte komplette Audiodateien mit Gesang, Text und kompletten Instrumentalarrangements.

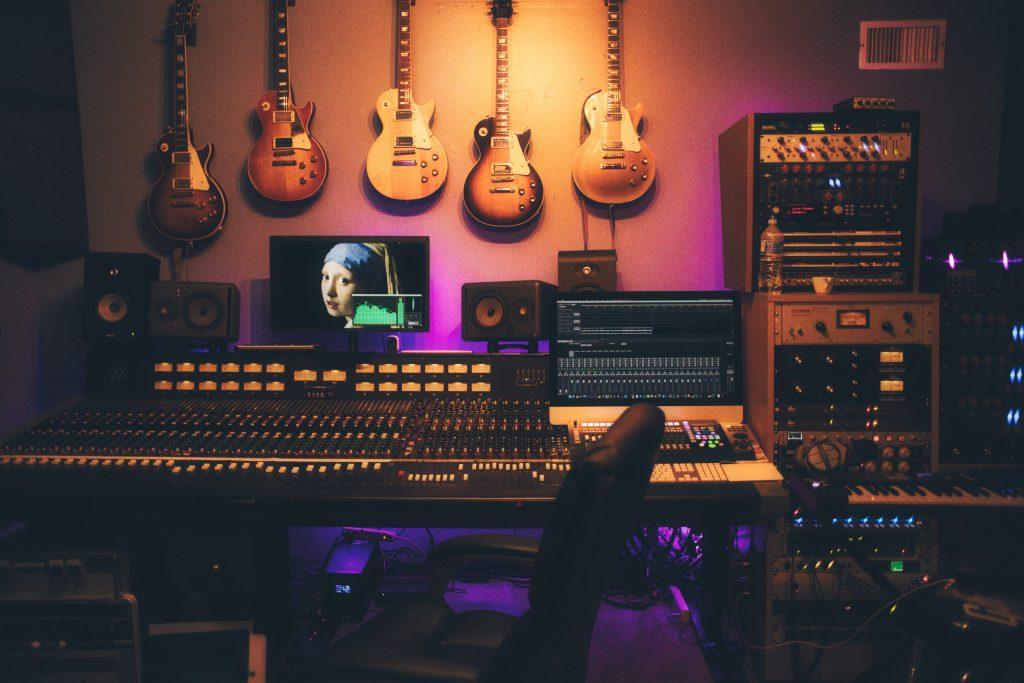

ChatGPT Music Generation

Im Dezember 2022 begannen mehrere Musikproduzenten damit, mit ChatGPT und einem anderen kostenlosen Tool namens UberDuck Meme-Videos von berühmten Rappern zu veröffentlichen. Diese spielerische Technik ist zum Spaß und zur Parodie gedacht – sie sollte nicht verwendet werden, um die Künstler ernsthaft zu imitieren. Und so funktioniert es:

- Die Nutzer geben eine Textaufforderung für ChatGPT ein, z. B. “Schreibe einen Text im Stil von [Künstler] über [Thema]”

- Finde einen Abschnitt des Textes, der dir gefällt, und gib ihn in UberDuck ein

- Exportiere das Audio aus Uberduck und bringe es in deine DAW

- Verwende ein Autotune-Plugin, um eine Melodie hinzuzufügen.

Das ist der beliebteste ChatGPT-Musikworkflow, den wir gefunden haben. Aber es gibt noch andere spannende Experimente, die wir als Nächstes vorstellen werden.

Unabhängige Forscher haben bereits begonnen, mit ChatGPT zu experimentieren, um textbasierte Vorschläge zur Verbesserung bestehender Akkordfolgen zu generieren.

ChatGPT-Akkordfolgen

Ein Twitter-Nutzer hat die Aufforderung “Ändere die folgende Progression so, dass sie mehr wie Bach ist” verwendet und eine textbasierte Akkordtabelle geliefert. Diese Ergebnisse mögen unterhaltsam sein, aber die natürliche Sprachverarbeitung von ChatGPT ist nicht multimodal. Das bedeutet, dass sie nicht in Musik ausgebildet wurde und sich keine ehrliche Meinung über ästhetische Verbesserungen bilden kann.

Ein ausgebildeter Komponist würde ChatGPTs Progression niemals mit Bachs Musik verwechseln. Aber es ist interessant zu sehen, wie gut es die ursprüngliche Akkordtabelle imitiert hat.

ChatGPT-Gitarrentabulatur

Gitarrentabulaturen sind ein weiteres interessantes Beispiel dafür, wie ChatGPT dazu genutzt werden kann, bestehende Musik zu überarbeiten. Ein Twitter-Nutzer schrieb “Setze dieses Gitarrenmuster fort”. Er gab eine Notation an, die jeder Gitarrist von Seiten wie Ultimate-Guitar kennt.

Was wir bekamen, war eher eine Nachahmung der Gitarrentabulatur als ein echter musikalischer Gedanke. Aber auch das ist das erste Mal, dass eine KI in der Lage ist, auf Aufforderungen zur Erstellung von Tabulaturen zu reagieren. Wenn du experimentierfreudig bist, könnte das ein lustiges Zufallsgenerator-Tool sein.

ChatGPT Lyrikerstellung

Ähnliche Anstrengungen wurden unternommen, um textbasierte Akkordtabellen mit der KI-Generierung von Liedtexten zu kombinieren. Das Ergebnis war visuell überzeugend. Twitter-Nutzer beschwerten sich jedoch, dass sie versucht hatten, die Melodien mit den Texten zu singen, aber es klang nicht gut.

Wenn ChatGPT also weder Musik versteht noch sinnvolle Inhalte generiert, können wir dann sinnvolle Verbesserungen in der KI-Musik erwarten? Die kurze Antwort lautet: Ja. Ich sage voraus, dass Spotify hier die Führung übernehmen wird.

Spotify: Der wahrscheinlichste Kandidat

Eines der beeindruckendsten Tools von Spotify heißt Basic Pitch und ermöglicht es den Nutzern, jedes beliebige Lied hochzuladen und es in weniger als einer Minute in MIDI-Dateien umzuschreiben. Diese MIDI-Dateien können dann kostenlos von der Website exportiert werden, was einen noch nie dagewesenen Zugang zu musikalischem Rohmaterial ermöglicht.

Spotify verfügt über eine nahezu unbegrenzte GPU-Leistung, eine riesige Audiodatenbank und umfangreiche Publikumsdaten, die das Unternehmen zum wahrscheinlichsten Akteur im Bereich der KI-Musik machen. Das könnte eine Erklärung dafür sein, warum Unternehmen wie Meta und OpenAI eher an der Text- und Bilderzeugung interessiert sind.

Soundtrap, eine DAW für Musikproduzenten von Spotify, würde wahrscheinlich die technische Seite dieser API-Aufrufe verwalten und die Nutzung des Musikgenerators monetarisieren. So könnten sie Geld einnehmen. Nicht nur für die Anschaffung der Audio-Workstation, sondern auch für die Erstellung zusätzlicher musikalischer Inhalte.

Wir haben bereits über KI-Mixing- und Mastering-Tools wie Spleeter und SongMastr berichtet, die den Mix eines bestehenden Tracks erkennen und versuchen, ihn auf einen Song anzuwenden. Es ist leicht vorstellbar, dass die Musikgenerator-Dienste von Spotify mit einem Mixing-Tool gekoppelt werden, um alle Bereiche abzudecken.

Das bedeutet, dass Berufsmusiker auf kurze Sicht sicher sind. Aber sie sollten sich darauf konzentrieren, menschliche Beziehungen aufzubauen und sich mit anderen zu vernetzen, anstatt sich in einem Studio einzuschließen. Langfristig könnte sich unsere Rolle als Musiker und Musikproduzent dahingehend verschieben, dass wir die künstliche Intelligenz mit Hinweisen füttern und ihre Produktion steuern, um den Anforderungen der Menschen gerecht zu werden, die die Musik brauchen.

Hoffen wir, dass die fantasievolle Seele der Menschheit nicht von dieser Technologie erdrückt wird. Ich würde lügen, wenn ich behaupten würde, dass mich die Automatisierung wichtiger kreativer Arbeit wie das Musikmachen nicht beunruhigt. Es steht außer Frage, dass KI unsere Welt verändern wird, aber ich bin zuversichtlich, dass sich dadurch auch neue Möglichkeiten ergeben werden.